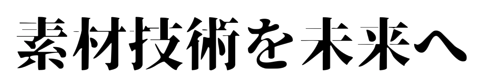

背景:エージェントAIの普及とMCPの役割

近年、自律的に目標を達成するために行動する「エージェントAI」の概念が急速に普及しています。これらのAIエージェントは、大規模言語モデル(LLM)を基盤とし、外部のツールやデータソースと連携することで、その能力を大幅に拡張します。この連携を可能にするデファクトスタンダードとなっているのが、Anthropicが開発し、現在はLinux FoundationのAgentic AI Foundationが管理する「モデルコンテキストプロトコル(MCP)」です。MCPは、月間9700万件以上のSDKダウンロードと17万7000件以上の登録ツールを記録するほど爆発的に採用が進んでいますが、この急速な普及が、潜在的なセキュリティリスクを伴っていることが指摘されています。

MCPのセキュリティにおける根本的な課題

本技術記事は、MCPがエージェントAIの相互運用性を促進する一方で、そのセキュリティに関する深刻なギャップが存在することを明らかにしています。根本的な問題は、これほど広範な相互接続性を持つプロトコルであるにもかかわらず、そのエコシステム全体を体系的に評価し、潜在的な脅威に対処するための統一された正式なセキュリティフレームワークが欠如している点です。AIエージェントが外部ツールやデータとやり取りする際、誤った情報へのアクセス、悪意のあるツールの誤用、データの漏洩、さらにはエージェント自体の乗っ取りといったリスクが生じる可能性があります。MCPの成功は、その設計がシンプルで柔軟であることに起因しますが、それが逆にセキュリティ対策の複雑さを増し、脆弱性を見過ごしやすくしている側面もあると考えられます。

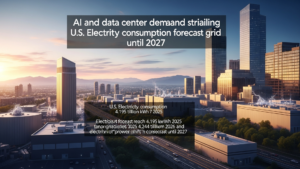

影響と将来展望:セキュリティフレームワークの緊急開発

MCPにおけるセキュリティギャップの指摘は、AIコミュニティ全体にとって重要な警鐘です。このままセキュリティ対策が不十分な状態でエージェントAIの利用が拡大すれば、ビジネスシステムや個人情報に対する大規模なサイバー攻撃、あるいはAIの誤動作による予期せぬ損害が発生する可能性があります。著者は、AI開発者、標準化団体、セキュリティ専門家に対し、MCPを利用するエージェントAIシステムのセキュリティを確保するための包括的なプロトコルとフレームワークを緊急に開発するよう強く提言しています。これには、認証、認可、データプライバシー保護、エージェントの行動監査、そしてインシデント対応計画の標準化などが含まれるでしょう。責任あるAIの発展のためには、イノベーションの加速と同時に、セキュリティと信頼性を確保するための基盤を確立することが不可欠です。

コメント