背景:AI時代のGPU性能とメモリの課題

現代のAIシステムは、膨大なデータ処理能力を要求し、その中核を担うのがGPUです。Nvidiaが製造するAI GPUは、その性能を最大限に引き出すために、従来のメモリ技術では不可能なレベルのメモリ帯域幅を必要とします。この「メモリウォール」と呼ばれるボトルネックを克服するために、高帯域幅メモリ(HBM)が不可欠なコンポーネントとして浮上しています。

HBMとCoWoSの重要性

-

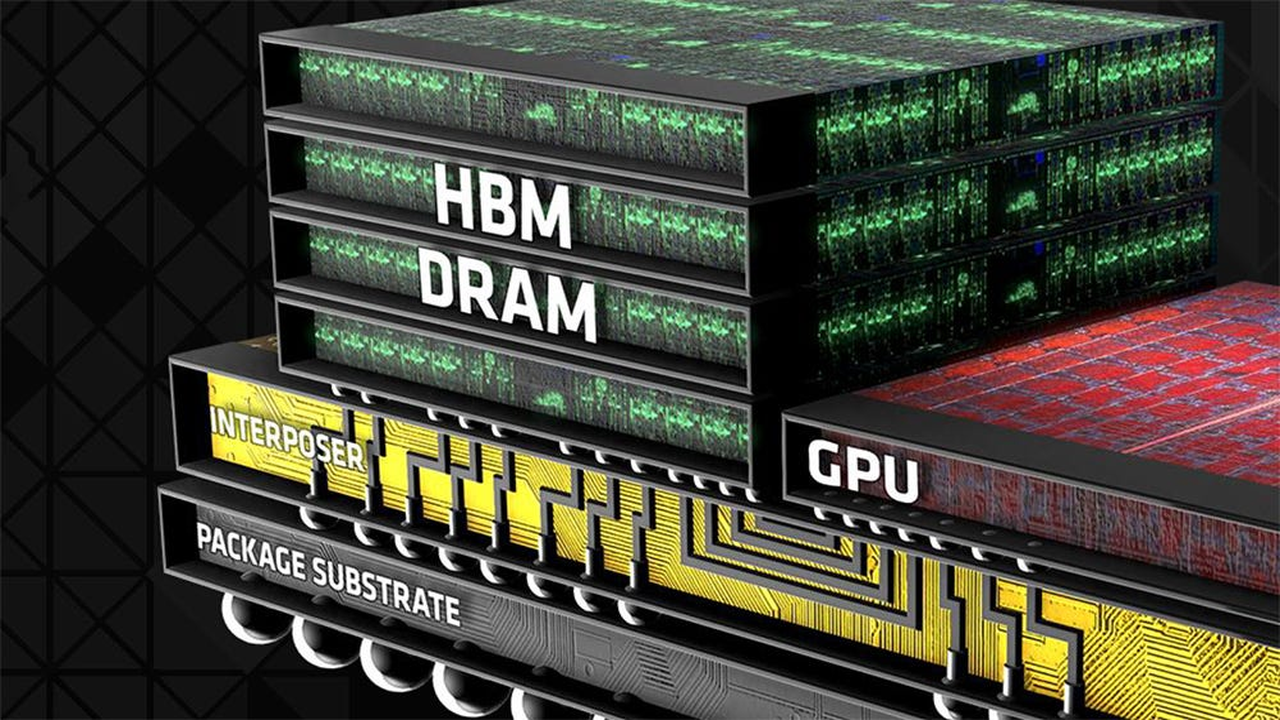

HBMの役割: HBMは、複数のDRAMダイを垂直に積層し、シリコンインタポーザとTSV(Through-Silicon Vias)を介してプロセッサに接続する革新的なメモリ技術です。これにより、従来のDRAMに比べて圧倒的なメモリ帯域幅を提供し、GPUがAI計算を効率的に実行できるようになります。SK HynixはHBM3Eの先駆者とされ、SamsungやMicronといった主要サプライヤーは、2026年のHBM生産能力がすでに完売しており、2027年以降も堅調な需要が続くと報告しています。次世代のHBM4では、メモリとプロセッサの協調設計を可能にするカスタムボトムチップが組み込まれる予定であり、さらなる性能向上が期待されます。

-

CoWoSの役割: HBMがデータ帯域幅を提供する一方で、TSMCのCoWoS (Chip-on-Wafer-on-Substrate)技術は、HBMとGPUダイを一つのパッケージ内に効果的に統合する役割を担います。CoWoSは、シリコンインタポーザ上に複数のチップを配置し、高度な相互接続を可能にする2.5Dパッケージング技術です。この技術がなければ、HBMの高性能をGPUに十分に活かすことはできません。したがって、HBMとCoWoSは、NvidiaやAMDのような企業が高性能AI GPUを出荷するために同等に不可欠な要素であり、両者のうち供給が遅い方が最終的な製品出荷量を決定する主要なボトルネックとなります。

業界への影響と展望

HBMとCoWoSの供給状況は、AIハードウェア市場全体の成長速度に直接的な影響を与えます。両技術への巨額な投資と生産能力の拡大が急務であり、その動向はNvidiaのようなAIリーダー企業の収益性だけでなく、AI技術の進化そのものにも影響を与えます。将来的には、これらの先進パッケージングとメモリ技術のさらなる統合と最適化が、次世代AIアクセラレータの性能を決定する鍵となるでしょう。

コメント