背景:AIブームが加速するクラウドインフラ投資

人工知能(AI)技術の爆発的な発展、特に生成AIや大規模言語モデル(LLM)の普及は、世界のクラウドサービスプロバイダー(CSP)にとって、前例のない規模の設備投資を促しています。AIモデルの学習(トレーニング)には膨大な計算資源が必要であり、さらに学習済みのモデルを実サービスで利用する「推論」の需要も、ユーザー数の増加とともに急増しています。このような状況は、Google、AWS、Metaといった主要なCSPに、AIアプリケーションを支えるための大規模なデータセンターインフラの構築を加速させています。今回の記事は、この巨額の投資がどこに向かい、CSPがどのような戦略的選択に迫られているのかを分析しています。

主要な投資動向と戦略的ジレンマ

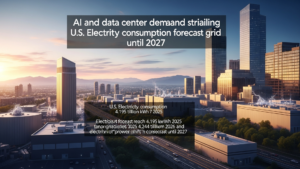

TrendForceの2026年2月25日付けレポートによると、Google、AWS、Metaを含む世界の主要CSP上位8社による2026年の設備投資総額は、前年比61%増の7100億ドルを超えるとの予測が出ています。この巨額の投資は、主にAIアプリケーションの拡大に起因しており、特にLLMの「トレーニング」から「推論」へのワークロードのシフトが重要な推進要因となっています。LLMのトレーニングは一度の大きな投資サイクルですが、推論はユーザーの利用が拡大するにつれて継続的に計算資源を要求するため、絶え間ないデータセンターの拡張が必要となります。この状況は、CSPが重要な戦略的ジレンマに直面していることを示唆しています。すなわち、AIワークロードの中心となるNVIDIAの高性能GPUへの依存を継続するか、あるいは自社で目的特化型集積回路(ASIC)を開発し、より効率的でコストを抑えたソリューションへと移行するかの選択です。

影響と今後の展望:AIインフラ競争の激化

7100億ドルを超えるAI投資は、単にAIサーバーの増設にとどまらず、汎用サーバーや高性能ネットワーク機器を含むデータセンター全体のインフラ構築に及んでいます。これは、AIアプリケーションの普及が、コンピューティング、ストレージ、ネットワーキングの各層にわたる包括的なインフラ増強を必要としていることを意味します。CSP間のAIインフラ競争は今後さらに激化し、それぞれの企業が独自のAIハードウェア戦略、効率的なデータセンター運用、そしてソフトウェア最適化を通じて差別化を図ろうとするでしょう。この競争は、最終的にAIサービスのコスト効率向上と性能改善に繋がり、AI技術のさらなる広範な社会実装を促進すると期待されます。また、電力消費量の増大やサプライチェーンの安定性といった課題にも対処しながら、持続可能なAIインフラの構築が今後の重要なテーマとなるでしょう。

元記事: https://blogs.itmedia.co.jp/business20/2026/04/2026csp7100ai.html

コメント